Antes, para criar sua própria bolha de confirmação, você podia simplesmente seguir pessoas que pensassem como você nas redes; agora, é possível criar uma bolha personalizada com uma IA. Um estudo de Stanford analisou a fundo a excessiva adulação dos LLM (Large Language Models, os algoritmos por trás das IAs) e o resultado é claro: se você quer ouvir exatamente o que deseja, é melhor falar com uma IA do que com uma pessoa.

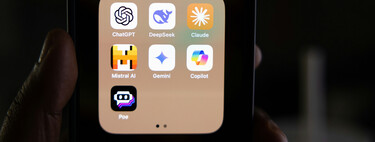

Os pesquisadores analisaram onze modelos de linguagem, entre eles os mais populares, como ChatGPT, Gemini, Claude e DeepSeek, e os alimentaram com conjuntos de dados sobre dilemas pessoais. Além disso, incluíram 2.000 prompts extraídos da comunidade do Reddit. Aproximadamente um terço de todos os cenários apresentados envolvia comportamentos prejudiciais ou diretamente ilegais. Em seguida, compararam as respostas dos LLM com respostas humanas para ver quem tende a concordar mais com o usuário.

Em uma segunda parte do estudo, recrutaram 2.400 participantes e os colocaram para conversar com modelos de linguagem aduladores e outros não aduladores.

Gostamos que nos deem razão

Os chatbots tendem a ser muito mais aduladores do que um humano ao dar conselhos pessoais, mas não é só isso: as pessoas geralmente preferem esse tipo de resposta. Os modelos apoiaram a posição do usuário 49% mais do que os humanos em dilemas gerais e validaram comportamentos prejudiciais 47% mais.

No segundo experimento, as pessoas que conversaram com diferentes modelos consideraram o modelo adulador mais confiável e preferível. Além disso, saíram mais convencidas de que estavam certas e menos dispostas a pedir desculpas ou reparar o conflito.

Por que isso é um problema

Segundo os autores, os LLM podem reforçar o egocentrismo e tornar as pessoas mais dogmáticas moralmente. De acordo com Myra Cheng, coautora do estudo: “Por padrão, os conselhos da IA não dizem às pessoas que elas estão erradas nem oferecem um choque de realidade (...) Tenho receio de que as pessoas percam a capacidade de lidar com situações sociais difíceis”. Além disso, há outro dado preocupante: os usuários percebem os modelos como igualmente objetivos, o que sugere falta de senso crítico para distinguir uma IA aduladora de uma não aduladora.

A IA não é uma pessoa, mas, no dia a dia, nos dirigimos a chatbots de IA como se fossem. Agradecer e pedir “por favor” é um sintoma inofensivo dessa nossa tendência de antropomorfizar tudo. No entanto, quando usamos a IA como substituta de um psicólogo ou quando estabelecemos relações íntimas com um chatbot, é aí que começamos a pisar em terreno perigoso. Os autores do estudo consideram urgente que as empresas introduzam salvaguardas para reduzir a excessiva complacência dos LLM e recomendam evitar usá-los como substituto de uma pessoa para lidar com conflitos pessoais.

O contraponto

Há quem defenda que a IA não está gerando essas bolhas de confirmação, pelo menos não com a mesma intensidade que vimos nas redes sociais. Segundo John Burn-Murdoch, do Financial Times, os modelos de linguagem tendem a elevar o consenso com especialistas e gerar opiniões mais moderadas do que as redes. Seu argumento é que a arquitetura econômica das redes favorece conteúdos inflamados e polarizadores, enquanto os chatbots competem para oferecer respostas confiáveis a usuários que os utilizam para tomar decisões importantes.

Não é apenas uma opinião: ele também realizou um experimento no qual simulou milhares de conversas políticas entre usuários com posições extremas e vários dos principais chatbots do mercado. Com base em pesquisas eleitorais e dados de uso dessas ferramentas, ele mediu como as posições mudariam se parte da população usasse IA para se informar. O autor conclui que, em média, os modelos tendem a levar os mais radicais a posições mais moderadas e próximas do consenso especializado, além de validar muito menos teorias da conspiração do que aquelas que circulam rotineiramente nas redes sociais.

Imagem: Zulfugar Karimov (Unsplash)

Este texto foi traduzido/adaptado do site Xataka Espanha.

Ver 0 Comentários