O DeepSeek é o nome mais famoso quando se fala em inteligência artificial na China. Ele não apenas apresenta um grande desempenho, como também gera influência: a própria Microsoft admite que ele está ganhando usuários em mercados nos quais veteranas como a OpenAI têm mais dificuldade. Outras empresas como Tencent ou Alibaba estão dando passos gigantes na disputa pela IA.

Mas os grandes não são os únicos e, com a China totalmente voltada para o desenvolvimento da robótica e da IA, é preciso falar de outros jogadores menores. Zhipu AI e MiniMax são dois dos “tigres” que, em apenas alguns anos, levantaram centenas de milhões de dólares e que contam com modelos que têm uma filosofia radicalmente diferente da da OpenAI e de outros gigantes ocidentais.

Seus modelos são vendidos como companheiros de vida, ferramentas que as pessoas possam usar no dia a dia sem se preocupar com o preço. E, dentro desse discurso, a MiniMax acaba de lançar o M2.5, um modelo que quer se tornar um “funcionário digital” e que seus responsáveis classificaram como seu primeiro “modelo de fronteira”, tão barato que não vale a pena nem medir o preço.

Uma IA barata demais para se preocupar com o preço

O M2.5 já é oficial e, como registra o South China Morning Post, a MiniMax não quis desperdiçar a oportunidade de lançá-lo em uma semana frenética para a indústria de IA na China. Tecnicamente, o M2.5 é um LLM — grande modelo de linguagem — com cerca de 230 bilhões de parâmetros totais, mas utiliza apenas 10 bilhões por token. Por ser um sistema Mixture of Experts, cada chamada envolve apenas os especialistas diretamente necessários para resolver a solicitação.

Traduzindo esse número para algo mais concreto, isso significa que é um modelo potente, mas que, por requisição de usuário, não utiliza todo o seu potencial, o que implica baixos custos de inferência e preços muito reduzidos para os usuários. Seus responsáveis afirmam que o preço é de apenas um dólar por hora de funcionamento contínuo, consumindo 100 tokens por segundo. Isso significa que você pode ter um “agente” trabalhando de forma contínua durante todo esse tempo a um custo entre 10 e 20 vezes menor do que outros modelos como Opus, Gemini 3 Pro ou GPT-5.

Essa política agressiva faz com que o M2.5 seja um modelo “barato demais para ser quantificado”, segundo seus responsáveis, facilitando essa adoção em massa porque o usuário pode deixar de otimizar cada comando que dá à IA. Essa expressão “too cheap to meter” é uma referência histórica ao famoso comentário segundo o qual a eletricidade proveniente da energia nuclear seria barata demais para sequer ser medida.

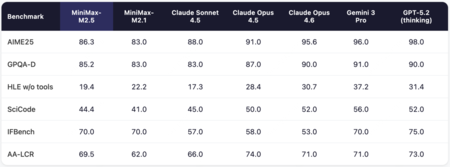

Pontuação interna em diferentes testes | Imagem: MiniMax

Pontuação interna em diferentes testes | Imagem: MiniMax

E algo importante é que o M2.5 não é um simples chatbot. Ele está disponível em plataformas como Ollama, HuggingFace, ModelScope na China e GitHub. A própria MiniMax afirma que 30% das tarefas internas da empresa já são realizadas pelo próprio M2.5. Além disso, 80% do código novo é gerado pelo modelo. Ou seja, ele está mais otimizado para trabalhar sozinho do que para conversar. Esse fenômeno de código sendo criado por código não é exclusivo do M2.5, e o Codex e o Opus também estão nesse mesmo caminho.

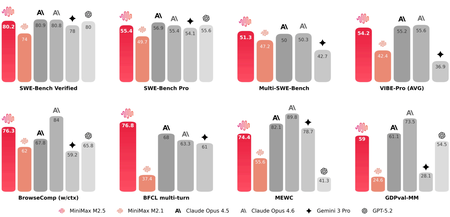

O modelo já foi colocado à prova e, embora em algumas tarefas consiga resultados notáveis, sobretudo em comparação com outros modelos open-weight, sua pontuação ainda fica distante da dos modelos fechados. Nos resultados internos da empresa, ele conseguiu dobrar a pontuação do modelo anterior, o M2.1, mas, como bem aponta o SCMP, essas métricas internas de referência são difíceis de verificar de forma independente.

Benchmark interno de coding | Imagem: MiniMax

Benchmark interno de coding | Imagem: MiniMax

No fim das contas, sendo mais ou menos capaz em comparação com outros modelos, o MiniMax M2.5 é mais um exemplo da estratégia que a China vem impulsionando com a inteligência artificial. Enquanto os Estados Unidos se esforçam para demonstrar que têm modelos proprietários cada vez mais potentes e sofisticados, a IA chinesa segue uma narrativa voltada a promover modelos mais baratos e úteis para o usuário.

Isso implica não apenas que tenham uma boa relação desempenho/preço, mas também que possam ser executados em dispositivos do dia a dia sem exigir uma enorme capacidade de processamento. E agora que, supostamente, certas empresas chinesas poderão ter acesso a algumas das melhores GPUs da NVIDIA para treinar IA, o impulso a essa estratégia pode ser significativo.

Imagens | MiniMax (editada)

Este texto foi traduzido/adaptado do site Xataka Espanha.

Ver 0 Comentários