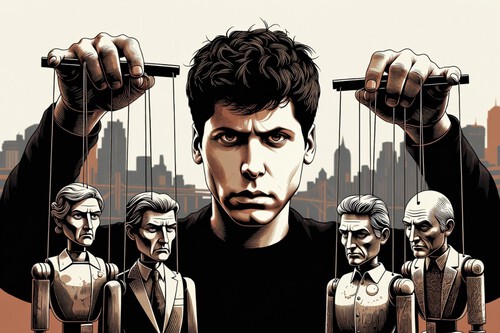

No último fim de semana , Sam Altman conversou com sua audiência no programa X para responder perguntas sobre o acordo que a OpenAI acaba de fechar com o Departamento de Defesa dos EUA. O que surgiu dessa sessão foi uma bela, ainda que não intencional, análise da maior contradição do setor atualmente.

Por que isso importa

O CEO da OpenAI disse estar apavorado com "um mundo onde empresas de IA agem como se tivessem mais poder que o governo". A frase soa bem, é voltada para o marketing e busca elevar a posição da OpenAI como um grupo poderoso, porém muito responsável e honesto.

O problema reside no contexto em que ela fez a declaração: horas antes da OpenAI assinar o acordo, o governo dos EUA classificou a Anthropic, sua concorrente direta, como um "risco para a cadeia de suprimentos" por se recusar a assinar sob as mesmas condições. Altman correu para apagar o incêndio justamente quando alguém a acusava de tê-lo iniciado.

Nas entrelinhas...

O argumento de Altman se baseia em uma premissa que precisa ser analisada: a de que um governo democraticamente eleito deve sempre prevalecer sobre empresas privadas não eleitas. É uma posição filosoficamente sólida, mas ele a aplica seletivamente.

Altman reconheceu que o acordo "foi apressado e não pega bem" e que a OpenAI agiu rapidamente para "diminuir" as tensões entre o Pentágono e a indústria. Em outras palavras, sua empresa tomou uma decisão estratégica unilateral sobre como toda a indústria de IA deveria se relacionar com o establishment militar. Isso não parece exatamente uma demonstração de deferência institucional.

O contraste

A Anthropic optou por algo diferente: exigir garantias explícitas contra o uso de sua IA para vigilância em massa ou armas autônomas. Mas o governo os penalizou. A OpenAI aceitou uma fórmula mais ambígua ("para todos os usos legais") e ganhou o contrato. Vários funcionários da OpenAI assinaram uma carta apoiando a posição da Anthropic .

Naquele fim de semana, Claude se tornou o aplicativo gratuito mais baixado na App Store da Apple, ultrapassando o ChatGPT. O mercado também tem suas opiniões.

Sim, mas...

É justo admitir que a posição de Altman possui uma certa lógica interna:

- Se a IA for de fato integrada aos sistemas militares, talvez seja preferível que isso ocorra sob condições negociadas em vez de sob coerção.

- E ele tem razão em um ponto: rotular a Anthropic como um risco para a cadeia de suprimentos, uma ferramenta destinada a fornecedores estrangeiros hostis, aplicada a uma empresa americana de segurança de IA é, em suas próprias palavras, "um precedente extremamente assustador"

A grande questão

Quem realmente decide como a IA é usada em contextos militares? As empresas que a desenvolvem, os governos que a contratam ou os engenheiros que a projetam e que estão cada vez mais se organizando para influenciar essas decisões?

Altman afirma acreditar no processo democrático. Mas a OpenAI negociou em privado, assinou em privado e tornou público apenas uma fração do contrato. A transparência democrática começa aí.

Ver 0 Comentários