Há alguns dias, a empresa chinesa Moonshot AI lançou o Kimi K2.6, seu novo modelo de lógica de aprendizado de máquina (LLM) que compete com as famílias de modelos Gemini, GPT e Claude e também é... especialmente competitivo em preço. Semanas antes, havia lançado o Kimi Code, um agente de programação de IA que compete com o Gemini CLI, Codex e Claude Code. A pergunta é óbvia: a combinação Kimi Code/Kimi K2.6 pode realmente competir com a popular combinação Claude Code/Opus 4.7? A resposta é complexa.

Um ótimo modelo (mas não perfeito)

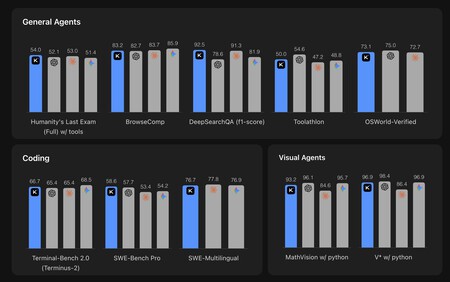

O Kimi K2.6 é um modelo de pesos abertos com um total de um trilhão de parâmetros, dos quais 32 bilhões são ativos, e utiliza a conhecida arquitetura Mixture-of-Experts. O artigo de lançamento mostra seu desempenho em comparação com o GPT-5.4 e o Opus 4.6, e seus números nesses benchmarks sintéticos são realmente excelentes:

Kimi K2.6 é comparado ao GPT-5.4, Claude Opus 4.6 e Gemini 3.1 Pro | Fonte: Moonshot AI

Kimi K2.6 é comparado ao GPT-5.4, Claude Opus 4.6 e Gemini 3.1 Pro | Fonte: Moonshot AI

Até 8 vezes mais barato que o Opus 4.6

Possui planos de assinatura semelhantes ao Claude Pro ou ChatGPT Plus, mas também pode ser usado via API. O preço, nesse caso, é de US$ 0,60 por milhão de tokens de entrada (US$ 0,16 se armazenado em cache) e US$ 4 por milhão de tokens de saída. O Claude Opus 4.6 custa US$ 5 por milhão de tokens para entrar e US$ 25 por milhão de tokens para sair — até oito vezes mais. O Claude Opus 4.7 tem o mesmo preço e, teoricamente, um desempenho melhor, mas quando o Kimi K2.6 foi anunciado, essa versão ainda não havia sido lançada (nem o GPT-5.5).

A magia do enxame de agentes de IA

O Claude Code funciona sequencialmente: ele analisa o problema, executa uma etapa, verifica o resultado e decide como prosseguir. Já o Kimi Code usa uma abordagem diferente: um "agente mestre" divide ou decompõe a tarefa solicitada em subtarefas independentes e, a partir dessa divisão, inicia até 300 "subagentes" que são executados em paralelo e são capazes de coordenar até 4 mil etapas simultaneamente.

É melhor ter muitos trabalhando juntos do que apenas um?

Este é o chamado "enxame de agentes" do Kimi K2.6, que é totalmente utilizado no Kimi Code e também pode ser ativado na versão gratuita disponível no site oficial. No Kimi K2.5, era possível executar até 100 subagentes e 1,5 mil etapas, portanto, o salto é significativo. Em testes internos, a Moonshot demonstrou como esses enxames, por exemplo, conseguiram "refatorar" um mecanismo financeiro de código aberto, trabalhando por 13 horas consecutivas e realizando mais de mil chamadas de ferramentas, com uma melhoria de 185% no desempenho médio. Obviamente, esses foram testes internos.

Além dos benchmarks

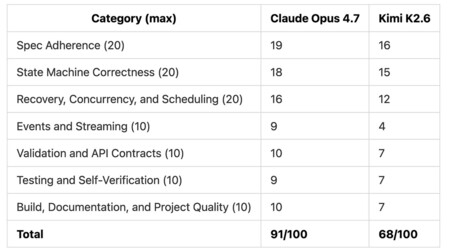

A Kilo.ai é uma empresa que desenvolve ferramentas como o Kilo Code e o Kilo CLI — agentes de programação semelhantes ao Kimi Code — e seus engenheiros queriam avaliar o desempenho de ambas as combinações. Claude Opus 4.7 e Kimi K2.6 receberam o mesmo prompt de 1.042 linhas para criar o FlowGraph, uma API de orquestração de fluxo de trabalho com validação de grafo direcionado e streaming de eventos em tempo real. Ambos os modelos foram executados no Kilo CLI, pois a comparação se concentrou exclusivamente nos próprios modelos.

Kimi foi mais barato, mas também apresentou mais falhas

Claude Opus 4.7 terminou em 20 minutos e custou US$ 3,56. Kimi K2.6 levou mais tempo, em parte devido à disponibilidade limitada do servidor (o modelo havia acabado de ser lançado), mas custou US$ 0,67 — cinco vezes menos.

Kimi K2.6 teve bom desempenho a um preço ridiculamente baixo; Claude teve um desempenho muito melhor, mas custou cinco vezes mais

Kimi K2.6 teve bom desempenho a um preço ridiculamente baixo; Claude teve um desempenho muito melhor, mas custou cinco vezes mais

Kimi fez 75% do que Claude fez, a um custo 19% menor

O problema é que ambos acreditavam ter feito tudo certo e não detectaram os erros cometidos. Uma análise mais aprofundada revelou que Claude cometeu um erro e Kimi, seis, de gravidade variável. Segundo os analistas da Kilo.ai, a pontuação final para ambos foi de 91 em 100 para o Opus 4.7 e 68 em 100 para Kimi.

Duas perspectivas sobre o assunto

Essa pontuação parece deixar claro que o Kimi é simplesmente mais barato porque teve um desempenho pior. Mas os engenheiros da Kilo tinham outra perspectiva. Eles vêm comparando modelos de ponderação abertos de empresas chinesas há algum tempo e perceberam como a diferença em relação aos modelos de ponta da Anthropic ou da OpenAI está se tornando cada vez menor.e ponta da Anthropic ou da OpenAI está se tornando menos acentuada.

"Por US$ 0,67 e com uma revisão completa, o Kimi K2.6 agora é uma opção viável. Por US$ 3,56 e exigindo menos correções, o Claude Opus 4.7 é a escolha mais segura. A escolha entre os dois depende da análise. Há um ano, essa escolha era praticamente inexistente nesse nível de complexidade."

Revisão é obrigatória

Em outras palavras: se, após trabalhar com o Kimi K2.6, alguém realizasse uma revisão e correção mais aprofundadas, é provável que todos esses erros fossem detectados e corrigidos. No entanto, se tivéssemos que confiar em ambos os modelos e pudéssemos executar apenas uma simulação de IA, o Opus 4.7 seria o vencedor. A chave é esta: você não deve confiar cegamente no código de nenhum modelo, e é sempre recomendável revisá-lo.

Fator geopolítico

Kimi e Kimi Code são originários da China, e a startup Moonshot AI conta com o apoio financeiro do Alibaba. O código processado por esses modelos passa pelos servidores do Alibaba, o que pode ser irrelevante para um desenvolvedor individual. No entanto, para uma empresa com código proprietário sensível, contratos que devem cumprir certas regulamentações europeias ou americanas e projetos em setores regulamentados, isso pode representar um obstáculo significativo. O Kimi Code atenua esse problema oferecendo a opção de executar o modelo localmente graças à sua arquitetura de código aberto, mas isso exige máquinas muito potentes e anula parte da vantagem de custo.

O que o Kimi Code tem que o Claude Code não tem

A diferença mais clara entre esses dois agentes de programação de IA é o paralelismo. Como mencionado, a capacidade de executar até 300 subagentes para trabalhar simultaneamente no mesmo problema é notável. Para analisar grandes repositórios ou gerar documentação massiva, essa diferença de velocidade é real e impressionante. Há outro elemento importante: o Kimi Code é agnóstico em relação ao modelo, permitindo o uso de modelos baseados em nuvem, como Claude, GPT ou Gemini, mas também modelos locais via Ollama. O Claude Code também aceita outros modelos, mas é um pouco mais complicado usá-lo com qualquer coisa além do Sonnet/Opus.

Conclusão: Viva as opções!

Aqui fica claro que o que os benchmarks internos indicam é muito diferente do que a experiência prática demonstra. A comparação da Kilo.ai é impressionante e reafirma duas coisas. Primeiro, que o Claude Opus 4.6/4.7 ainda é superior aos modelos de ponderação abertos de empresas chinesas. Segundo, e mais importante, que ele não é mais tão superior assim. A diferença de desempenho está diminuindo, mas enquanto isso acontece, o fator custo entra em jogo: se o "modelo chinês" for bom o suficiente para você (e está se tornando cada vez mais), você economizará muito dinheiro. Anthropic, OpenAI e Google deveriam se preocupar.

Imagem | Chris Ried

Ver 0 Comentários