A Apple parece estar costurando, peça por peça, um futuro em que os AirPods deixam de ser apenas fones premium para se tornarem dispositivos biométricos avançados, talvez até leitores de ondas cerebrais. A nova pista vem de um estudo publicado por pesquisadores da empresa, que apresenta um método de aprendizado de máquina chamado PARS (PAirwise Relative Shift). O objetivo? Ensinar um modelo de IA a compreender a estrutura dos sinais elétricos do cérebro sem depender de dados previamente anotados por humanos.

Hoje, modelos que analisam EEG — aquele registro elétrico da atividade neural — precisam de especialistas indicando manualmente trechos correspondentes a estágios do sono, eventos epilépticos e outras ocorrências. É caro, demorado e limita a escala desse tipo de tecnologia. O PARS tenta driblar esse gargalo com uma abordagem autossupervisionada: o modelo aprende sozinho a estimar a distância temporal entre pequenos segmentos de EEG, tudo a partir de dados crus, sem rótulos.

Na prática, em vez de “preencher lacunas” como fazem métodos tradicionais, o PARS busca entender relações de longo alcance entre diferentes ondas cerebrais. E isso funcionou surpreendentemente bem. Em quatro benchmarks distintos — incluindo detecção de crises epilépticas, estágios do sono e análise motora — o modelo da Apple igualou ou superou técnicas anteriores.

Será que teremos AirPods lendo nossos cérebros?

Será que teremos AirPods lendo nossos cérebros?

Mas onde entram os AirPods nessa história?

Um dos conjuntos de dados usados no estudo, o EESM17, traz registros captados por um sistema ear-EEG, ou EEG pelo ouvido. Essa tecnologia, ainda pouco comum, consegue detectar diversos padrões cerebrais mesmo sem os eletrodos tradicionais espalhados pelo couro cabeludo. E ela conversa diretamente com outro ingrediente importante: a patente registrada pela Apple em 2023 para “um dispositivo eletrônico vestível capaz de medir biossinais”.

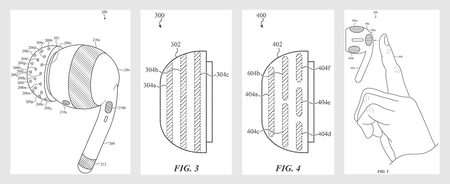

A patente descreve literalmente um sistema de ear-EEG integrado a um dispositivo de ouvido — citando suas vantagens e dificuldades, como a necessidade de customizar eletrodos para formatos de orelha diferentes. A solução proposta pela empresa? Encher o dispositivo (leia-se: AirPods) com vários sensores redundantes e usar uma IA para escolher automaticamente quais oferecem o melhor sinal, levando em conta ruído, contato com a pele, impedância e até o posicionamento no ouvido.

O documento vai além: menciona gestos de toque ou aperto para iniciar medições, combina sinais de múltiplos eletrodos em uma única forma de onda otimizada e cita aplicações como monitoramento do sono e detecção de anomalias neurais — exatamente os casos de uso explorados no estudo atual.

Parte da patente da Apple

Parte da patente da Apple

Vale reforçar: o estudo não menciona AirPods, e não há ligação direta com a patente. Mas a coincidência tecnológica é barulhenta demais para ser ignorada, como notou o 9to5mac. De um lado, a Apple desenvolve hardware para registrar sinais cerebrais via ouvido; do outro, cria modelos de IA capazes de interpretá-los sem anotações humanas.

Se isso vai virar um produto comercial? Ainda é cedo para dizer. Mas o caminho parece estar sendo criado para que, em um futuro não tão distante, seus AirPods saibam mais sobre seu cérebro do que você imagina.

Crédito de imagem: Xataka Brasil via Perplexity, Apple

Ver 0 Comentários